Jennifer Dewan, Directrice principale des communications

Le Technology Innovation Institute présente Falcon 180B : le LLM open source le plus puissant au monde

- Abou Dhabi, Émirats arabes unis - mercredi, 06. septembre 2023

- AETOSWire

- Le nouveau modèle occupe une place pionnière dans le classement des LLM d’accès libre de Hugging Face.

- Le modèle composé de 180 milliards de paramètres utilise 3,5 billions de jetons, surpassant 4 fois les ressources de calcul de LLaMA 2 de Meta.

- Falcon 180B est en accès libre pour les chercheurs et les utilisateurs commerciaux

Le Technology Innovation Institute (TII) des Émirats arabes unis (EAU) repousse une fois de plus les limites de l'IA générative avec le lancement de son modèle de langage à grande échelle (LLM) Falcon 180B, qui reflète une itération avancée de son produit phare. Cette version révolutionnaire vise à renforcer le statut prééminent des Émirats arabes unis dans le domaine de l'IA, offrant Falcon 180B tel un modèle d’accès libre pour la recherche et l'utilisation commerciale.

Par suite du succès remarquable réalisé par Falcon 40B, un modèle d'IA open source qui s'est rapidement hissé au sommet du classement LLM de Hugging Face en mai 2023, TII, le pilier de la recherche appliquée du Conseil de recherche en technologies avancées (ATRC) d'Abou Dhabi, continue de diriger le secteur de l’IA générative. Falcon 40B représente l'un des premiers modèles open source destinés aux chercheurs et aux utilisateurs commerciaux, et est parvenu à réaliser un progrès pionnier dans le domaine.

Soulignant l'impact positif de Falcon sur la perspective de l'IA, S.E. Faisal Al Bannai, secrétaire général du Conseil de recherche en technologie avancée (ATRC) a déclaré : « Nous envisageons un avenir dans lequel le pouvoir révolutionnaire de l'IA sera à la portée de tous. Nous nous engageons à démocratiser l’accès à l’IA avancée, puisque notre vie privée et l’impact potentiel de l’IA sur l’humanité ne doivent pas être contrôlés par quelques privilégiés. Même si nous ne disposons peut-être pas de toutes les réponses, notre détermination reste inébranlable. Nous sommes déterminés à collaborer et contribuer à la communauté open source, en veillant à ce que les avantages de l’IA soient partagés par tous ».

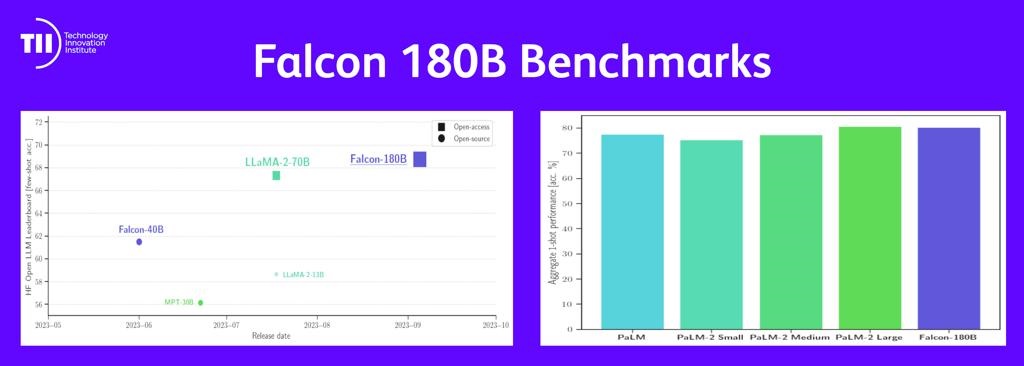

Composé de 180 milliards de paramètres, considéré un nombre impressionnant, et entraîné sur 3.5 billions de « tokens » (ou jetons en français), Falcon 180B avance remarquablement au sommet du classement des LLM pré-entraînés de Hugging Face. Il surpasse en effet des concurrents notables comme le LLaMA 2 de Meta dans divers tests, y compris les tests de raisonnement, de codage, de compétence et de connaissances.

Parmi les meilleurs LLM closed source, Falcon 180B se classe juste derrière le plus récent GPT 4 développé par OpenAI et est à égalité avec les performances de PaLM 2 Large de Google, le modèle équipant Bard – bien qu'il soit la moitié de la taille du modèle. Le cadre de licence du modèle est établi sur la « licence Falcon 180B TII », construite sur les principes du logiciel Apache 2.0.

Pour sa part, le Dr Ebtesam Almazrouei, directrice exécutive et chercheuse en chef par intérim de l’unité transversale d'intelligence artificielle (IA) du TII, a dit : « Le lancement de Falcon 180B illustre notre dévouement à repousser les frontières de l'IA, et nous sommes ravis de partager son potentiel illimité avec le monde. Falcon 180B annonce une nouvelle ère d'IA générative, où le progrès scientifique potentiel est rendu disponible grâce au libre accès, ce qui permet d’alimenter les innovations de l’avenir. Alors que nous explorons les frontières de la science et de la technologie, notre vision s'étend bien au-delà de l'innovation ; il s'agit d’entretenir des liens solides pour relever les défis mondiaux grâce à des percées collaboratives ».

Avec plus de 12 millions de développeurs adoptant et déployant la première version de Falcon, cette mise à niveau substantielle est en passe de devenir le premier modèle dans divers domaines, depuis les chatbots à la génération de code, et au-delà.

Falcon 180B est compatible avec les principales langues suivantes : anglais, allemand, espagnol et français, mais ses capacités sont limitées en italien, portugais, polonais, néerlandais, roumain, tchèque et suédois.

Pour de plus amples informations, veuillez consulter le lien suivant : FalconLLM.tii.ae.

Le texte du communiqué issu d’une traduction ne doit d’aucune manière être considéré comme officiel. La seule version du communiqué qui fasse foi est celle du communiqué dans sa langue d’origine. La traduction devra toujours être confrontée au texte source, qui fera jurisprudence.

Contacts

Languages

Multimedia

Tweets by TIIuae