Jennifer Dewan, vrchní ředitelka pro komunikaci

Jennifer.dewan@tii.ae

Technologický inovační institut (TII), přední světové vědecko-výzkumné centrum a pilíř aplikovaného výzkumu Rady pro pokročilý technologický výzkum (ATRC) v Abú Dhabí, uvedl na trh nový velkojazyčný model řady Falcon, Falcon Mamba 7B. Nový model je č. 1 v celosvětovém měřítku výkonný open source jazykový model SSLM (State Space Language Model) na světě, jak nezávisle ověřila společnost Hugging Face.

Jako první SSLM pro Falcon se odchyluje od předchozích modelů Falcon, které všechny používaly architekturu založenou na transformaci. Tento nový model Falcon Mamba 7B je dalším příkladem průkopnického výzkumu, který institut provádí, a průlomových nástrojů a produktů, které zpřístupňuje komunitě ve formátu „open source“.

J. E. Faisal Al Bannai, generální tajemník ATRC a poradce prezidenta SAE pro strategický výzkum a záležitosti pokročilých technologií, řekl: „Všichni se těšíme na další úspěch: „Falcon Mamba 7B je čtvrtým nejlépe hodnoceným modelem umělé inteligence v řadě, což posiluje postavení Abú Zabí jako globálního centra výzkumu a vývoje umělé inteligence. Tento úspěch podtrhuje neochvějný závazek SAE v oblasti inovací.“

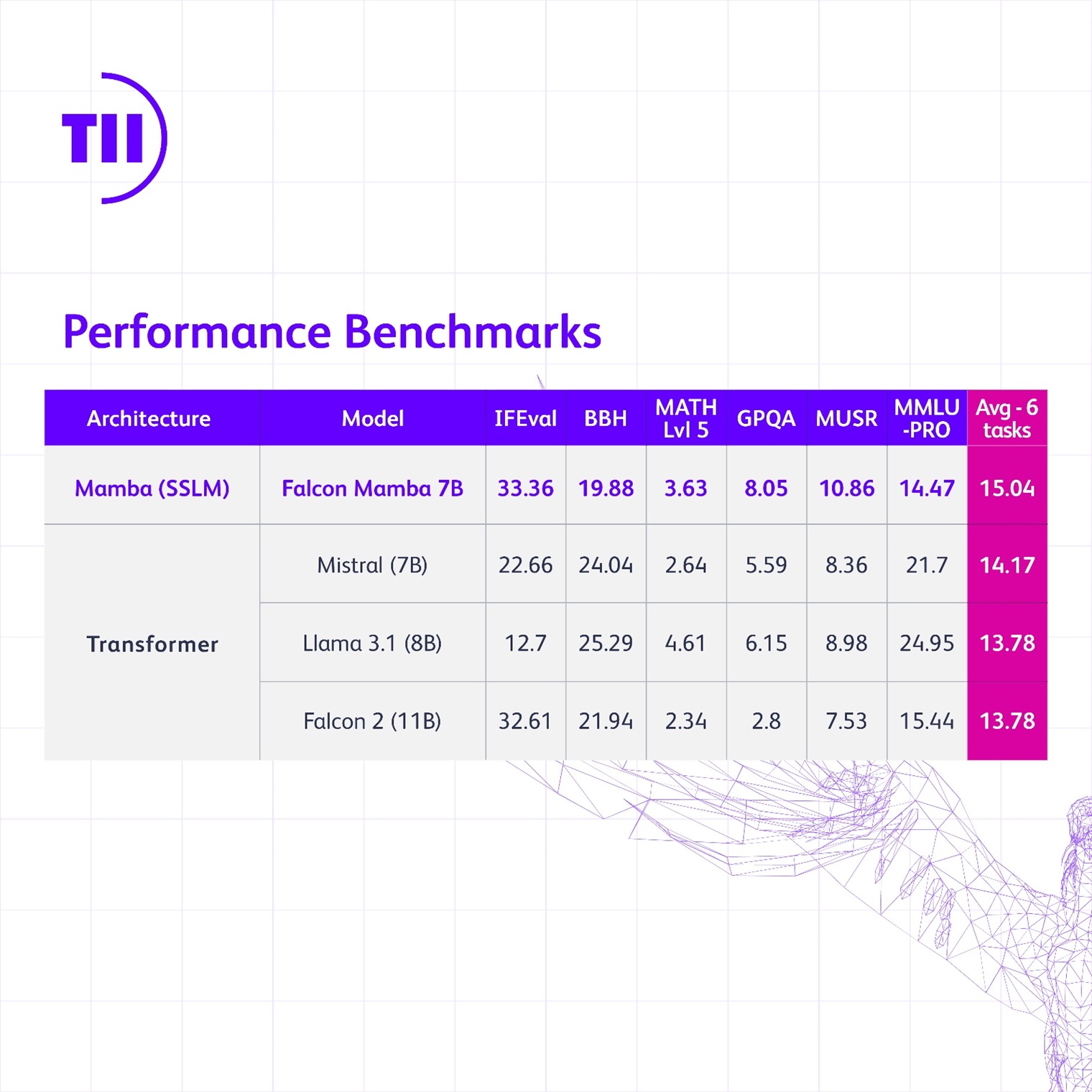

U modelů s transformační architekturou Falcon Mamba 7B překonává modely Meta Llama 3.1 8B, Llama 3 8B a Mistral 7B v nově zavedených benchmarcích od HuggingFace. Zatímco u ostatních SSLM Falcon Mamba 7B poráží všechny ostatní open source modely ve starých benchmarcích a bude prvním modelem v novém žebříčku náročnějších benchmarků HuggingFace.

Dr. Najwa Aaraj, výkonná ředitelka společnosti TII, řekla: „V tomto případě se jedná o velmi důležitý krok: „Technologický inovační institut pokračuje v posouvání hranic technologií díky své řadě modelů umělé inteligence Falcon. Falcon Mamba 7B představuje skutečnou průkopnickou práci a otevírá cestu budoucím inovacím v oblasti umělé inteligence, které rozšíří lidské schopnosti a zlepší život.“

Modely State Space jsou mimořádně výkonné při chápání složitých situací, které se vyvíjejí v čase, jako je například celá kniha. Je tomu tak proto, že SSLM nevyžadují další paměť, aby mohly zpracovat tak velké kousky informací.

Modely založené na transformaci jsou naproti tomu velmi efektivní při zapamatování a využití informací, které zpracovaly dříve v sekvenci. Díky tomu jsou velmi dobré v úlohách, jako je generování obsahu, nicméně protože porovnávají každé slovo s každým jiným slovem, vyžaduje to značný výpočetní výkon.

SSLM mohou najít uplatnění v různých oblastech, jako je odhadování, prognózování a řídicí úlohy. Podobně jako modely s transformační architekturou vynikají také v úlohách zpracování přirozeného jazyka a lze je použít pro strojový překlad, sumarizaci textu, počítačové vidění a zpracování zvuku.

Dr. Hakim Hacid, úřadující vedoucí výzkumný pracovník oddělení TII pro umělou inteligenci, řekl: „Při představování letounu Falcon Mamba 7B jsem hrdý na ekosystém spolupráce TII, který se postaral o jeho vývoj. Toto vydání představuje významný krok vpřed, inspiruje k novým perspektivám a dále podporuje snahu o inteligentní systémy. V TII posouváme hranice SSLM i transformačních modelů, abychom podnítili další inovace v oblasti generativní umělé inteligence.“

Modely Falcon LLM byly staženy více než 45 milionkrát, což dokazuje jejich mimořádný úspěch. Falcon Mamba 7B bude vydán pod licencí TII Falcon License 2.0, permisivní softwarovou licencí založenou na Apache 2.0, která obsahuje zásady přijatelného použití, jež podporují zodpovědné používání umělé inteligence. Více informací o novém modelu naleznete na adrese FalconLLM.TII.ae.

Text této zprávy v původním, zdrojovém jazyce je oficiální verzí. Překlad této zprávy do jiných jazyků poskytujeme pouze jako doplňkovou službu. Text zprávy v původním, zdrojovém jazyce je jedinou právně závaznou verzí této tiskové zprávy.

Jennifer Dewan, vrchní ředitelka pro komunikaci

Jennifer.dewan@tii.ae