जेनिफ़र देवान, वरिष्ठ संचार निदेशक

यूएई के टेक्नॉलजी इनोवेशन इंस्टिट्यूट ने नए आर्किटेक्चर के साथ एआई (AI) भाषा मॉडल में क्रांति ला दी

- आबू धाबी, संयुक्त अरब अमीरात - मंगलवार, 13. अगस्त 2024

- AETOSWire

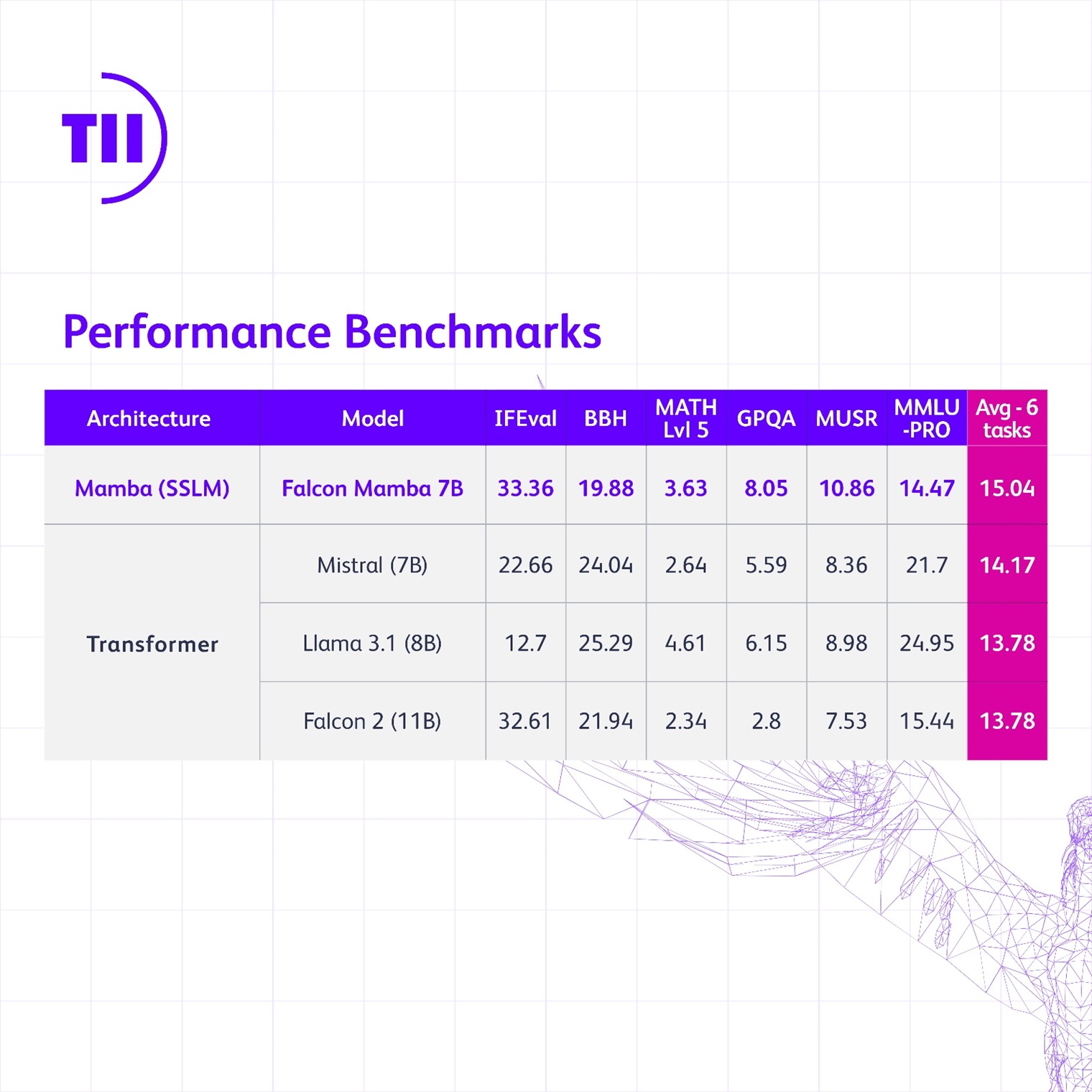

- Hugging Face ने स्वतंत्र रूप से पुष्टि की है कि Falcon Mamba 7B विश्व में सर्वोच्च प्रदर्शन करने वाला ओपन-सोर्स स्टेट स्पेस लैंग्वेज मॉडल (SSLM) है।

- SSLM की मेमरी की लागत कम होती है और उन्हें टेक्स्ट के मनमाने लंबे ब्लॉक जनरेट करने के लिए अतिरिक्त मेमरी की ज़रूरत नहीं पड़ती है

- प्रदर्शन के मामले में, Falcon Mamba 7B पारंपरिक ट्रांसफ़ॉर्मर आर्किटेक्चर मॉडल जैसे Meta के Llama 3.1 8B और Mistral के 7B को भी पीछे छोड़ देता है

- नए मॉडल में अबू धाबी की एआई (AI) अनुसंधान और विकास की नवीन और अभूतपूर्व पद्धति स्पष्ट दिखाई देती है।

दुनिया के अग्रणी साइंटिफ़िक रिसर्च सेंटर में से एक और अप्लाइड रिसर्च के स्तंभ आबूधाबी के एडवांस्ड टेक्नॉलजी रिसर्च काउंसिल (ATRC) के टेक्नॉलजी इनोवेशन इंस्टिट्यूट (TII) ने अपनी Falcon सीरीज़ में Falcon Mamba 7B नामक एक नया बड़ा भाषा मॉडल जारी किया है। Hugging Face ने स्वतंत्र रूप से पुष्टि की है कि यह नया मॉडल विश्व में सर्वोच्च प्रदर्शन करने वाला ओपन-सोर्स स्टेट स्पेस लैंग्वेज मॉडल (SSLM) है।

ट्रांसफ़ॉर्मर-आधारित आर्किटेक्चर का इस्तेमाल करने वाले पिछले सभी Falcon मॉडल के विपरीत, यह Falcon के लिए पहला SSLM है। यह नया Falcon Mamba 7B मॉडल इस संस्थान द्वारा किए जा रहे अग्रणी अनुसंधान का और समुदाय को ओपन सोर्स फ़ॉर्मेट में उपलब्ध कराए जा रहे सफल उपकरणों और उत्पादों का एक और उदाहरण है।

ATRC के प्रधान सचिव और सामरिक अनुसंधान और उन्नत प्रौद्योगिकी मामलों के लिए यूएई राष्ट्रपति के सलाहकार, महामहिम फ़ैसल अल बन्नाई ने कहा: “Falcon Mamba 7B, TII का लगातार चौथा टॉप-रैंकिंग एआई (AI) मॉडल है, जो एआई (AI) अनुसंधान और विकास के वैश्विक केंद्र के रूप में आबू धाबी की स्थिति को मज़बूत करता है। यह उपलब्धि कुछ नया कर दिखने के प्रति यूएई की अटूट प्रतिबद्धता को हाइलाइट करती है।"

हाल ही में जारी किए गए HuggingFace बेंचमार्क के आधार पर, Falcon Mamba 7B ट्रांसफ़ॉर्मर आर्किटेक्चर मॉडल Llama 3.1 8B, Llama 3 8B और Mistral के 7B से बेहतर प्रदर्शन करता है। दूसरी ओर, Falcon Mamba 7B, पिछले बेंचमार्क में अन्य सभी ओपन सोर्स मॉडल से आगे निकल गया है और HuggingFace के नए, ज़्यादा कठिन बेंचमार्क लीडरबोर्ड पर पहला मॉडल होगा।

TII की मुख्य कार्यकारी अधिकारी डॉ. नजवा आराज ने कहा: “टेक्नॉलजी इनोवेशन इंस्टीट्यूट ने एआई (AI) मॉडल की अपनी Falcon सीरीज़ के ज़रिए टेक्नॉलजी की सीमाओं को आगे बढ़ाना जारी रखा है। Falcon Mamba 7B वास्तव में अभूतपूर्व कार्य का एक उत्कृष्ट उदाहरण है, जो आगामी एआई (AI) विकास का मार्ग प्रशस्त करता है, जिससे मानव क्षमता में वृद्धि होगी और जीवन में सुधार आएगा।"

स्टेट स्पेस मॉडल समय के साथ विकसित होने वाली जटिल स्थितियों, जैसे कि पूरी किताब को समझने में बेहद कामयाब होते हैं। ऐसा इसलिए है, क्योंकि SSLM को इतनी बड़ी मात्रा में सूचना को प्रोसेस करने के लिए अतिरिक्त मेमरी की ज़रूरत नहीं होती है।

दूसरी ओर, ट्रांसफ़ॉर्मर आधारित मॉडल, अनुक्रम में पहले प्रोसेस की गई जानकारी को याद रखने और इस्तेमाल करने में बहुत कुशल होते हैं। हालाँकि, क्योंकि वे हर शब्द की तुलना हर दूसरे शब्द से करते हैं, इसलिए वे कॉन्टेंट जनरेशन जैसे कामों के लिए बहुत अच्छे होते हैं, लेकिन इसके लिए बहुत ज़्यादा कम्प्यूटेशनल शक्ति की ज़रूरत होती है।

SSLM का इस्तेमाल कई अलग-अलग क्षेत्रों में किया जा सकता है, जिनमें अनुमान, पूर्वानुमान और नियंत्रण कार्य शामिल हैं। ट्रांसफ़ॉर्मर आर्किटेक्चर मॉडल की तरह, वे प्राकृतिक भाषा प्रोसेसिंग से जुड़े कार्यों में अच्छा प्रदर्शन करते हैं और इसका इस्तेमाल मशीनी अनुवाद, पाठ के संक्षेपण, कंप्यूटर विज़न और ऑडियो प्रोसेसिंग में किया जा सकता है।

TII की AI क्रॉस-सेंटर यूनिट के कार्यकारी मुख्य शोधकर्ता डॉ. हकीम हाकिद ने कहा: “Falcon Mamba 7B को पेश करते हुए, मुझे TII के सहयोगात्मक माहौल पर गर्व है जिसने इसके विकास को बढ़ावा दिया। यह रिलीज़ एक बड़ा कदम है, जो नए विचारों को प्रोत्साहित करेगा और बुद्धिमान प्रणालियों की खोज को आगे बढ़ाएगा। TII में, हम जनरेटिव एआई (AI) में और नवाचार को बढ़ावा देने के लिए SSLM और ट्रांसफ़ॉर्मर मॉडल, दोनों की सीमाओं को आगे बढ़ा रहे हैं।"

Falcon LLM को 45 मिलियन से ज़्यादा बार डाउनलोड किया गया है, जो मॉडल की उत्कृष्ट सफलता को साबित करता है। Falcon Mamba 7B को TII Falcon License 2.0 के तहत रिलीज़ किया जाएगा, जो Apache 2.0-आधारित सॉफ़्टवेयर लाइसेंस है, जिसमें एक स्वीकार्य उपयोग नीति शामिल है जो AI के ज़िम्मेदार उपयोग को बढ़ावा देती है। नए मॉडल के बारे में और जानकारी FalconLLM.TII.ae पर मिल सकती है।

Contacts

Languages

Multimedia

Tweets by TIIuae