Jennifer Dewan, Senior Director of Communications

Jennifer.dewan@tii.ae

Technology Innovation Institute di UEA Rombak Language Model AI Dengan Arsitektur Baru

- ABU DHABI, Uni Emirat Arab - Rabu, 14. Agustus 2024

- AETOSWire

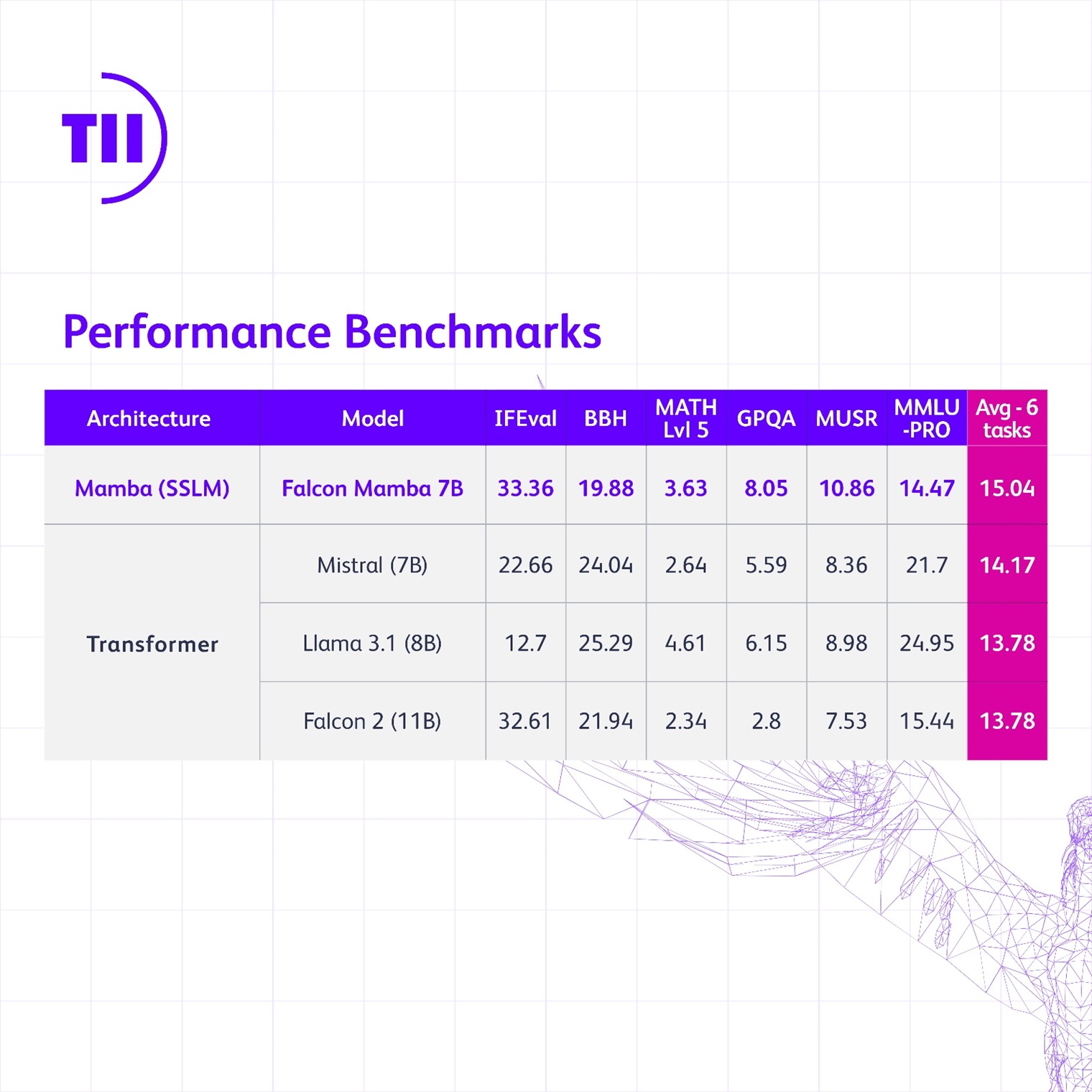

- Falcon Mamba 7B adalah State Space Language Model (SSLM) open source dengan kinerja no. 1 di dunia berdasarkan verifikasi independen oleh Hugging Face

- Biaya memori SSLM tidak mahal dan tidak memerlukan memori tambahan untuk menghasilkan blok teks panjang sesukanya

- Falcon Mamba 7B juga mengungguli model arsitektur transformer tradisional seperti Llama 3.1 8B milik Meta dan 7B milik Mistral

- Model baru ini mencerminkan inovasi dan pendekatan terobosan di Abu Dhabi dalam hal penelitian dan pengembangan AI

(BUSINESS WIRE)-- Technology Innovation Institute (TII) adalah pusat penelitian ilmiah yang terkemuka di dunia dan pilar penelitian terapan milik Advanced Technology Research Council (ATRC) Abu Dhabi. TII merilis Large Language Model baru seri Falcon, yaitu Falcon Mamba 7B. Model baru ini merupakan State Space Language Model (SSLM) open source dengan kinerja terbaik di dunia berdasarkan verifikasi independen oleh Hugging Face.

Sebagai SSLM pertama untuk Falcon, model ini berbeda dari model Falcon sebelumnya yang semuanya menggunakan arsitektur transformer. Model Falcon Mamba 7B baru ini adalah contoh lain dari penelitian pelopor yang dilakukan TII dan berbagai alat maupun produk terobosan yang disediakannya bagi masyarakat dalam format open source.

Kata Y.M. Faisal Al Bannai, Sekretaris Jenderal ATRC dan Penasihat Presiden UEA untuk Urusan Penelitian Strategis dan Teknologi Canggih: “Falcon Mamba 7B merupakan model AI peringkat teratas keempat berturut-turut milik TII yang memperkuat Abu Dhabi sebagai pusat global untuk riset dan pengembangan AI. Pencapaian ini menegaskan keteguhan komitmen UEA terhadap inovasi.”

Untuk model arsitektur transformer, Falcon Mamba 7B mengungguli Llama 3.1 8B dan Llama 3 8B milik Meta, dan 7B milik Mistral berdasarkan tolok ukur baru dari HuggingFace. Sedangkan untuk SSLM lainnya, Falcon Mamba 7B mengalahkan semua model open source lain berdasarkan tolok ukur lama dan akan menjadi model pertama di papan peringkat tolok ukur HuggingFace yang baru dan lebih tangguh.

Kata Dr. Najwa Aaraj, Chief Executive TII: “Technology Innovation Institute terus mendobrak batasan teknologi melalui rangkaian model AI Falcon. Falcon Mamba 7B adalah karya pionir sejati dan mempersiapkan inovasi AI masa depan yang akan meningkatkan kemampuan manusia dan memperbaiki kehidupan.”

Model State Space sangat hebat dalam memahami situasi kompleks yang berkembang seiring waktu, misalnya seluruh buku. Karena SSLM tidak memerlukan memori tambahan untuk mencerna informasi dalam jumlah besar.

Sebaliknya, Model transformer sangat efisien dalam mengingat dan menggunakan informasi yang telah diproses dalam urutan. Karena itu, model ini sangat tepat untuk tugas seperti pembuatan konten. Tapi karena model ini membandingkan setiap kata dengan setiap kata lain, maka perlu daya komputer yang signifikan.

SSLM dapat diaplikasikan di berbagai bidang seperti estimasi, perkiraan, dan tugas pengawasan. Mirip dengan model arsitektur transformer, SSLM juga unggul untuk tugas Natural Language Processing dan dapat diaplikasikan pada terjemahan mesin, peringkasan teks, Computer Vision, dan pemrosesan audio.

Kata Dr. Hakim Hacid, Acting Chief Researcher AI Cross-Center Unit di TII: “Saat kami memperkenalkan Falcon Mamba 7B, saya bangga dengan ekosistem kolaboratif di TII yang mendukung pengembangannya. Peluncuran ini merupakan langkah maju yang signifikan dan menginspirasi perspektif baru serta semakin mendorong pencarian sistem cerdas. Di TII, kami mendobrak batasan model SSLM maupun model transformer untuk memicu inovasi lebih lanjut di bidang AI generatif.”

Falcon LLM telah diunduh lebih dari 45 juta kali, hal ini membuktikan kesuksesan besar model-model tersebut. Falcon Mamba 7B akan diluncurkan dengan TII Falcon License 2.0, lisensi perangkat lunak Apache 2.0 yang mencakup kebijakan penggunaan yang dapat diterima dan mendukung penggunaan AI secara bertanggung jawab. Informasi lebih lanjut tentang model baru ini terdapat di FalconLLM.TII.ae.

Tersedia Galeri Multimedia/Foto: https://www.businesswire.com/news/home/54107705/en

Pengumuman ini dianggap sah dan berwenang hanya dalam versi bahasa aslinya. Terjemahan-terjemahan disediakan hanya sebagai alat bantu, dan harus dengan penunjukan ke bahasa asli teksnya, yang adalah satu-satunya versi yang dimaksudkan untuk mempunyai kekuatan hukum.